日本ニュース24時間 — 韓国で広まっている人工知能(AI)アプリによる低品質な行為について、性犯罪の懸念が高まっています。

アプリが問題視される理由

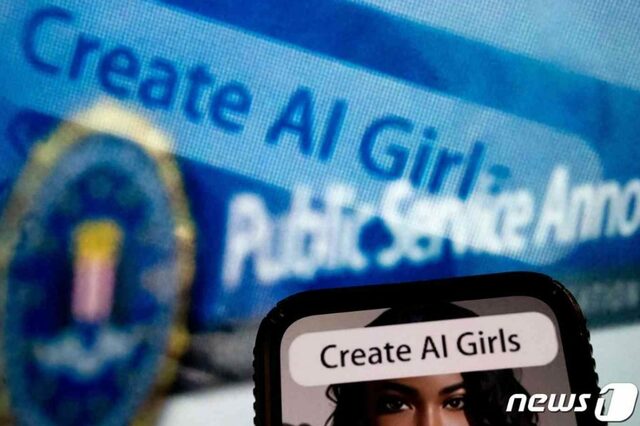

「ヌーディファイ」「アンドレス」「ディープヌード」といったウェブサイトやアプリが問題になっています。これらのサイトでは、人々の写真に対して服を脱いだ状態のイメージを創作することができます。

報告書によると、海外のコミュニティサイト「レディット」やX、テレグラムを中心に広まっており、約2400万人もの人々が9月の1カ月間でこのようなサイトを訪れていました。

犯罪への損害と対策

これらのアプリ運営会社は高画質などを謳って有料機能で収益を上げており、価格帯は1.99ドル(約288円)から299ドル(約4万2500円)までさまざまです。

被写体本人の同意なしにこのようなアプリを使用することは、名誉毀損や侮辱、わいせつ物流布罪など法的責任を問われる可能性があります。被害者は損害賠償請求も行うことができます。

韓国の弁護士は、「肖像権侵害から無断使用など民事的な損害賠償責任を問うこともできるが、本人が所蔵しているだけでは限界がある」と指摘しています。

性犯罪の被害を防ぐために、韓国政府はこのような低品質なAIアプリに対する対策を検討する必要があります。

もっと読む: 日本ニュース24時間